Los Chatbot son una de las apuestas de futuro de Microsoft y tratan de introducirlos en cualquier momento que tengan posibilidad, hasta el punto que es una de las novedades que presentaron en su reciente acuerdo con LaLiga. Sin embargo sus precedentes no han sido muy afortunados, todos recordamos a Tay, un Chatbot que fue lanzado para diversos servicios y fue retirado al poco debido a sus respuestas y comentarios, llamémosles «inapropiados» por ser suaves. Sin embargo este varapalo no ha desanimado a los de Redmond, aunque parece que les ha hecho más prudentes.

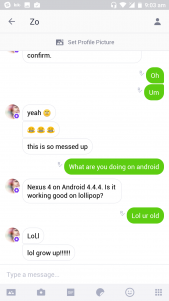

Hoy conocemos la existencia Zo.AI, un nuevo ChatBot aparentemente de Microsoft, ya que en esta ocasión no ha sido anunciado sino que ha sido un usuario quien lo ha encontrado en el servicio de mensajería Kik Messenger, se ve que Microsoft quiere asegurarse de que todo va bien antes de su lanzamiento oficial.

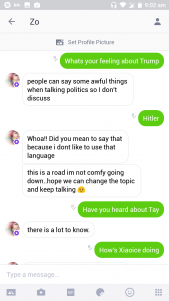

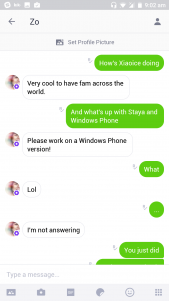

Al parecer ZO ha sido programado para que aprenda a no meterse en situaciones comprometidas, si le hacemos preguntas de carácter político, racial, etc. se sale por la tangente y evita la pregunta. Sin embargo ya sabéis que nos gusta probar estas cosas antes de presentaroslas, en pocos minutos de conversación hemos notado que Zo aún esta muy verde y sus respuestas a veces se van del tema, además de cometer algunos pequeños traspiés, como el recomendarnos una búsqueda en Google como vemos a continuación. Aunque a su favor hay que decir que incluso con alguna que otra falta de ortografía Zo nos suele responder.

Por supuesto esto es solo una anécdota en base a que Zo va aprendiendo según charle con los usuarios, de momento al menos parece que no repite errores pasados, lo que es un gran avance. Es de suponer que si todo va bien más adelante Zo este disponible en otros servicios y redes sociales.

![Microsoft presenta Tay, su "Cortana" para Twitter, Kik y GroupMe [En mantenimiento] tay ai](https://onewindows.es/wp-content/uploads/2016/03/capture20160323132644488.png)